Cybercriminalité en Asie du Sud-Est : quand les organisations criminelles s'emparent de l'IA

Office des Nations-Unis contre la Drogue et le Crime | Septembre 2025 Le rapport « Menaces émergentes : l’intersection entre l’innovation criminelle et technologique dans l’utilisation de l’automatisation et de l’intelligence artificielle dans le paysage de la cybercriminalité en Asie du Sud-Est » détaille comment les organisations criminelles transnationales opérant en Asie du Sud-Est exploitent l’automatisation et l’intelligence artificielle pour amplifier, sophistiquer et dissimuler leurs activités cybercriminelles (fraudes, arnaques, blanchiment, trafic d’êtres humains et exploitation sexuelle en ligne). Les opérations d’escroquerie transnationales fusionnent désormais avec d’autres formes de criminalité grave, notamment la traite des êtres humains et les flux financiers illicites à grande échelle. Ces réseaux s’appuient sur des facilitateurs communs, banques souterraines, blanchiment par cryptomonnaies et exploitation des lacunes juridictionnelles et réglementaires, pour créer un environnement criminel hautement adaptatif et technologiquement structuré.

Le rapport « Menaces émergentes : l’intersection entre l’innovation criminelle et technologique dans l’utilisation de l’automatisation et de l’intelligence artificielle dans le paysage de la cybercriminalité en Asie du Sud-Est » détaille comment les organisations criminelles transnationales opérant en Asie du Sud-Est exploitent l’automatisation et l’intelligence artificielle pour amplifier, sophistiquer et dissimuler leurs activités cybercriminelles (fraudes, arnaques, blanchiment, trafic d’êtres humains et exploitation sexuelle en ligne). Les opérations d’escroquerie transnationales fusionnent désormais avec d’autres formes de criminalité grave, notamment la traite des êtres humains et les flux financiers illicites à grande échelle. Ces réseaux s’appuient sur des facilitateurs communs, banques souterraines, blanchiment par cryptomonnaies et exploitation des lacunes juridictionnelles et réglementaires, pour créer un environnement criminel hautement adaptatif et technologiquement structuré.

Les études de cas présentées dans le rapport illustrent concrètement comment l’automatisation et l’IA sont exploitées à des fins criminelles en Asie du Sud-Est et dans le Pacifique. Entre 2024 et 2025, en Thaïlande et au Cambodge, les brigades cyber de la police thaïlandaise ont démantelé deux réseaux majeurs d’escroquerie exploitant des technologies deepfake en temps réel. Le premier, opérant depuis Chiang Mai, combinait arnaque aux sentiments et escroquerie à l’investissement via des appels vidéo à visages synthétiques. Le second, basé à Poipet au Cambodge, usurpait l’identité de forces de l’ordre grâce à l’outil « AIFace« . Au total, 139 suspects ont été arrêtés.

En février 2025, le Département des investigations spéciales thaïlandais (DSI) a engagé des poursuites contre un ressortissant thaïlandais en possession de plus de 20.000 fichiers de contenus pédopornographiques, dont au moins un généré par IA. Cette affaire soulève des questions juridiques essentielles sur l’absence de cadre légal spécifique aux contenus synthétiques.

Captures d’écran de contenus deepfake mettant en scène le Premier ministre de Singapour, diffusées sur les réseaux sociaux. Source : CNA, 2025.

Captures d’écran de contenus deepfake mettant en scène le Premier ministre de Singapour, diffusées sur les réseaux sociaux. Source : CNA, 2025.

En Malaisie, dès 2024, des vidéos falsifiées mettant en scène le Premier ministre et des membres du gouvernement ont été diffusées massivement sur les réseaux sociaux pour promouvoir de faux schémas d’investissement, érodant la confiance du public dans les communications officielles.

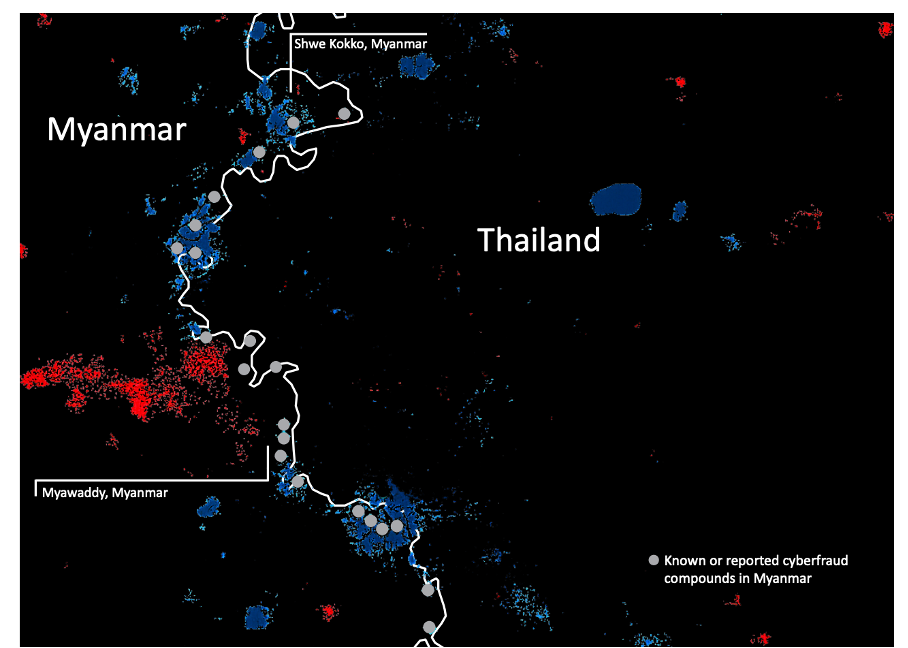

Évolution de l’éclairage nocturne autour de Myawaddy (2021–2024) et localisation des complexes de cyberfraude Les zones en bleu signalent une augmentation de l’éclairage nocturne ; les zones en rouge indiquent une diminution. Les symboles localisent les complexes de cyberfraude identifiés ou signalés dans la région (Myawaddy, Shwe Kokko), opérés sous contrôle de groupes armés non étatiques et associés à la traite des êtres humains à des fins de travail forcé.Sources : NASA Black Marble, UNODC (2023–2024), International Justice Mission.

Évolution de l’éclairage nocturne autour de Myawaddy (2021–2024) et localisation des complexes de cyberfraude Les zones en bleu signalent une augmentation de l’éclairage nocturne ; les zones en rouge indiquent une diminution. Les symboles localisent les complexes de cyberfraude identifiés ou signalés dans la région (Myawaddy, Shwe Kokko), opérés sous contrôle de groupes armés non étatiques et associés à la traite des êtres humains à des fins de travail forcé.Sources : NASA Black Marble, UNODC (2023–2024), International Justice Mission.

L’intégration de l’intelligence artificielle dans les usages criminogènes transforme radicalement le paysage. Les réseaux criminels adoptent l’IA pour accroître l’échelle, l’efficacité et la capacité d’adaptation de leurs opérations. Du code généré par IA peut être intégré dans des malwares capables de s’adapter dynamiquement à leur environnement, réduisant les risques de détection. Des cyberattaques autonomes et des campagnes de phishing optimisées par l’IA défient désormais les cadres conventionnels de prévention et d’investigation. Enfin, des réseaux de machines ou d’appareils connectés infectés par un logiciel malveillant, des botnets, sont désormais capables de scanner les vulnérabilités, de contourner les mécanismes de vérification et de maintenir des campagnes à haut volume avec une supervision humaine minimale.

L’automatisation : L’automatisation (processus par lequel des tâches sont exécutées par des scripts ou des logiciels sans intervention humaine) permet aux cybercriminels d’étendre la portée, la vitesse et l’efficacité de leurs opérations tout en minimisant l’effort manuel. Cette évolution s’articule autour de six axes principaux. Le phishing (hameçonnage) reste le cybercrime le plus courant, mais il est devenu bien plus dangereux grâce aux plateformes de Phishing-as-a-Service (PhaaS) et aux kits prêts à l’emploi. Des kits comme « 16shop », originaire d’Indonésie, se vendent entre 60 et 150 dollars, permettant à des attaquants peu qualifiés de créer instantanément des clones parfaits de sites comme Apple ou Amazon. Environ 3,4 milliards d’e-mails de phishing sont envoyés quotidiennement dans le monde, représentant 1,2 % du trafic e-mail global.

Les botnets (réseaux d’appareils infectés sous le contrôle d’un attaquant) permettent de lancer des attaques massives comme l’envoi de milliards de spams ou des attaques par déni de service (DDoS). L’Asie du Sud-Est, avec ses nombreux objets connectés (IoT) mal sécurisés, constitue une cible privilégiée, comme en témoigne le malware Mirai. C’est un logiciel qui prend le contrôle de milliers d’appareils connectés mal protégés (caméras de surveillance, routeurs, télévisions intelligentes) pour les transformer en une armée numérique capable de submerger et paralyser des sites ou des infrastructures entières. Le credential stuffing (bourrage d’identifiants) consiste à tester automatiquement des milliards de combinaisons d’identifiants volés sur de multiples sites. Au premier trimestre 2022, plus de 10 milliards de tentatives ont été enregistrées mondialement, représentant 34 % de l’activité totale de connexion. La distribution de malware à grande échelle s’appuie sur des kits d’exploitation intégrés dans des sites compromis, scannant les navigateurs des visiteurs pour exécuter des téléchargements furtifs (téléchargement malveillant qui s’exécute automatiquement sur l’appareil d’un visiteur dès qu’il consulte un site web compromis, sans qu’il ait cliqué sur quoi que ce soit ni donné son accord) sans aucune interaction de l’utilisateur.

L’automatisation facilite également le blanchiment des produits illicites. Des bots sont utilisés pour ouvrir des comptes mules à l’aide d’identités volées ou fabriquées, automatisant la saisie de formulaires, le téléchargement de documents et le contournement des CAPTCHA. Une fois opérationnels, ces comptes sont scriptés pour fragmenter les fonds en petits montants (une technique appelée smurfing) avant de les convertir en cryptomonnaies ou de les faire transiter par des mélangeurs (mixers) qui brouillent les traces des transactions. Europol estime que 90 % de l’activité des mules est liée à la cybercriminalité. L’automatisation structure également les escroqueries en ligne à grande échelle. Les groupes criminels d’Asie du Sud-Est combinent systèmes de messagerie en masse, auto-dialeurs (compositeurs automatiques d’appels) et logiciels VoIP (logiciels de téléphonie par internet comme Skype, WhatsApp ou Zoom) pour cibler des victimes à grande échelle. Des « fermes » de cartes SIM (SIM box farms) expédient des milliers de messages frauduleux par minute, tandis que sur les réseaux sociaux, des bots diffusent des liens vers des plateformes d’investissement fictives. À l’intérieur des centres d’escroquerie, des travailleurs victimes de traite utilisent des modèles scriptés et des tableaux de bord de type CRM (outils de gestion de relation-client) pour gérer simultanément de multiples conversations.

Saisie de matériels d’interception Stingray dans un centre commercial et un véhicule à Bangkok (CCIB, 2024)

Saisie de matériels d’interception Stingray dans un centre commercial et un véhicule à Bangkok (CCIB, 2024)

Les usages de l’IA à finalités criminogènes L’intelligence artificielle transforme en profondeur le paysage de la cybercriminalité en Asie du Sud-Est, offrant aux acteurs criminels des capacités inédites de tromperie, d’attaque et de dissimulation. Les deepfakes, contenus synthétiques générés par IA, sont au cœur des nouvelles formes d’escroquerie. En 2024, un employé d’une multinationale à Hong Kong a été trompé et a transféré 25 millions de dollars après une visioconférence entièrement falsifiée. Des outils comme « AIFace » permettent désormais de superposer en temps réel le visage d’un tiers sur celui d’un opérateur lors d’un appel vidéo. Ces technologies sont également exploitées à des fins de « sextorsion » et de production de contenus pédopornographiques synthétiques.

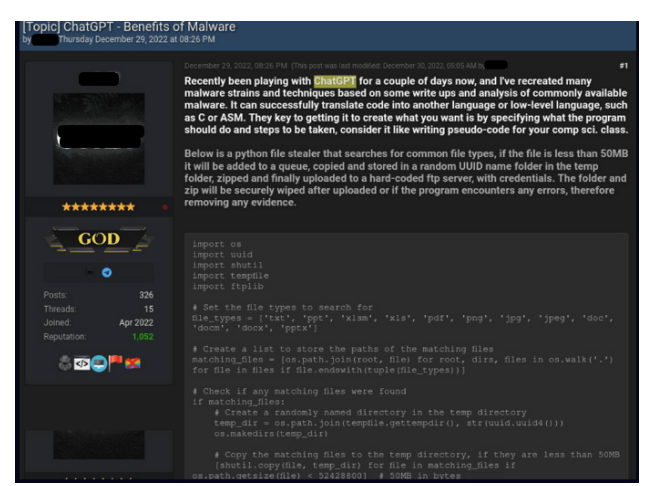

L’IA est également exploitée pour développer des malwares plus furtifs et plus efficaces. Des modèles de langage (LLM) sont détournés via des techniques de contournement des restrictions (jailbreak) pour générer automatiquement du code malveillant, abaissant drastiquement le niveau de compétence requis. Des variantes polymorphes, comme BlackMamba, modifient leur propre code pour échapper aux antivirus, tandis que des outils dédiés comme WormGPT opèrent sans aucune restriction éthique.

Un cybercriminel présentant la création d’un infostealer à l’aide d’un outil d’intelligence artificielle générative. Source : CheckPoint

Un cybercriminel présentant la création d’un infostealer à l’aide d’un outil d’intelligence artificielle générative. Source : CheckPoint

Les ransomwares améliorés par l’IA représentent une menace croissante, avec une hausse de 85 % des attaques en Asie en 2023. Ces variantes analysent automatiquement les environnements cibles, identifient les actifs critiques et ajustent leurs demandes de rançon en fonction de la capacité financière des victimes, simulant même des négociateurs humains multilingues. L’ingénierie sociale pilotée par l’IA amplifie considérablement la portée des escroqueries. Des chatbots alimentés par des LLM conduisent simultanément des conversations multilingues avec des victimes, tandis que des identités numériques entièrement synthétiques (photos, profils, documents ) sont générées pour instaurer une relation de confiance durable avant de rediriger les victimes vers des plateformes d’investissement fictives. L’IA sert également à protéger les réseaux criminels eux-mêmes. Des systèmes de reconnaissance faciale commerciaux sont détournés pour surveiller les forces de l’ordre, tandis que des technologies de face-swapping dissimulent l’identité des opérateurs lors d’interactions vidéo. La génération automatisée de faux documents et d’identités artificielles contourne les procédures de vérification KYC (Know Your Customer), ouvrant la voie à la fraude financière et au blanchiment d’argent à grande échelle.

par Sandrine Le Bars

Voir le rapport ici

ou https://www.unodc.org/roseap/uploads/documents/Publications/2025/UNODC_Report_Emerging_threats_-_The_intersection_of_criminal_and_technological_innovation_in_the_use_of_automation_and_AI.pdf

| Désolé, cette page est seulement accessible aux abonnés de crimorg.com! |

|---|